Что означают частотные характеристики мониторов?

При выборе монитора часто возникает проблема с определением его реальных возможностей и необходимых при работе. Рассмотрим минимальные требования к современному монитору. Ключевыми параметрами здесь являются максимальное разрешение, поддерживаемое монитором, и частота обновления кадров. Разрешение обозначает количество отображаемых элементов на экране (точек) по горизонтали и вертикали, например: 1024×768. Физическое разрешение зависит в основном от размера экрана и диаметра точек экрана (зерна) электронно-лучевой трубки экрана (для современных мониторов — 0.28-0.25). Соответственно, чем больше экран и чем меньше диаметр зерна, тем выше разрешение. Максимальное разрешение обычно превосходит физическое разрешение электронно-лучевой трубки монитора, поэтому использовать монитор с максимальным разрешением постоянно — только ломать глаза. Если ваше рабочее разрешение, т.е. разрешение, с которым вы собираетесь работать постоянно, является для монитора граничным — вам необходим монитор с большей диагональю. Частота кадров при рабочем разрешении должна быть 75 Гц и выше, иначе ваши глаза будут уставать. При максимальном разрешении допустима более низкая частота кадров. Ниже приведены типичные характеристики мониторов, на которые следует ориентироваться.

Для 14″ монитора: разрешение до 1024×768, реально используемые (рабочие) — 640×480 и 800×600. Частота развертки при разрешении 640×480 и 800×600 — 75-85 Гц, 1024×768 — 60 Гц.

Для 15″ монитора: разрешение до 1280×1024, реально используемые — 1024×768, 800×600 и ниже. Частота развертки при разрешении 640×480, 800×600 — 75-100Гц, 1024×768 — 75-85Гц, 1280×1024 — 60Гц.

Для 17″ монитора: разрешение до 1280×1024, реально используемые — 1024×768, 800×600. Частота развертки при разрешении 640×480, 800×600 — 75-110Гц, 1024×768 — 75-85Гц, 1280×1024 — 60-75Гц.

Требования к монитору можно определить с помощью таблиц 1 и 2. Например, попробуем подобрать монитор для типичного домашнего компьютера. Рабочее разрешение 800×600 — этого хватит для большинства приложений и игрушек, частота вертикальной развертки — 85Гц. Также желательна поддержка разрешения 1024×768 при 60 Гц. По таблице 1 находим полосу видеосигнала — 58 МГц для 800×600 и 64 МГц для 1024×768. По таблице 2 находим частоту горизонтальной развертки — 53 кГц для 800×600 и 48 кГц для 1024×768. В итоге получаем следующие требования: максимальное разрешение — не ниже 1024×768, полоса пропускания — не ниже 65 МГц, частота кадров — до 85 Гц, частота строк — до 53 кГц.

Что такое частота обновления экрана монитора и как она влияет на восприятие

Содержание

Содержание

Частота обновления экрана — один из самых неоднозначных параметров монитора. Одни утверждают, что чем она выше, тем лучше, а малая частота снижает качество изображения и вредит зрению. Другие уверены, что высокая частота — это для тех, кому деньги девать некуда, и что глаз все равно не различает частоту выше 25 Гц. Истина, как всегда, где-то посредине.

Что такое частота обновления экрана?

Вне зависимости от того, что мы видим на экране — статичную картинку или динамичный видеоролик — монитор постоянно выводит на экран серию изображений. Просто в первом случае все кадры будут более-менее одинаковы, а во втором расположение деталей на экране будет меняться от кадра к кадру, создавая иллюзию движения. Частота же смены кадров и есть «частота обновления экрана».

Совсем как в кино, поэтому многие вспоминают про стандартные для кинофильмов 24 кадра в секунду, т.е. 24 Гц. Если в кинотеатре никто не жалуется на «низкую частоту обновления», так зачем на мониторе нужно больше?

Существует устойчивый миф, что 24 Гц — это максимальная частота, воспринимаемая человеческим глазом. И что именно поэтому выбран такой стандарт для кино, а более высокая частота кадров просто не имеет смысла.

Развеять этот миф очень просто — достаточно запустить на компьютере какую-нибудь игру, позволяющую задавать скорость вывода кадров на экран (FPS). Игру лучше выбрать попроще, чтобы видеосистема уверенно обеспечивала высокий FPS. Попробуйте выставить в ней сначала FPS 24 и понаблюдать, а потом выше — например, 50. В динамичных сценах разница будет очевидна.

В кино это не так заметно из-за того, что каждый кадр фильма снимается с некоторой выдержкой, поэтому движущиеся объекты будут смазаны. Это смягчает переход от кадра к кадру и дополнительно «убеждает» наш мозг в том, что объект движется.

Кстати, многие игры также научились «смазывать» объекты, обеспечивая более плавное движение при невысоком FPS. Этот эффект называется motion blur. А частота кадров в кино была выбрана скорее из экономических показателей: меньше частота кадров — короче пленка и проще механика киноаппарата и проектора. Нужна была частота, которая обеспечивает более-менее плавное движение на экране, но при этом не требует больших затрат. Почему именно 24? Потому что при такой частоте минутный расход пленки составлял ровно 30 ярдов, что упрощало расчет количества пленки и, соответственно, бюджета съемок.

60 Гц — мало или достаточно?

Еще один миф, связанный с частотой обновления экрана, — это вред для глаз. Дескать, мониторы с низкой частотой обновления мерцают, что ведет к усталости глаз и, в перспективе, даже к заболеваниям. Следует признать, что это не совсем миф — мерцающее изображение действительно вредно для зрения. И мониторы действительно могут мерцать. Вот только это никак не связано с частотой обновления экрана.

Раньше, когда все мониторы делались на основе электронно-лучевых трубок (ЭЛТ), причиной мерцания экрана действительно была частота обновления. В ЭЛТ люминофор на экране светится только в момент «пробегания» по нему электронного луча. Поэтому чем меньше была «частота монитора», тем заметнее мерцал экран. 60 Гц для такого монитора было совершенно недостаточно.

Однако изображение на экране ЖК-монитора не гаснет в промежутке между обновлениями кадров. Да, на некоторых мониторах заметно мерцание, но не из-за обновления экрана, а из-за режима работы ламп подсветки. Фактически, на статичном изображении нет никакой разницы между мониторами с частотой обновления в 60 Гц и 200 Гц. Если вы используете монитор для работы, в высокой частоте нет необходимости. 60 Гц вполне достаточно.

Не требуется высокая частота и в том случае, если вы любите смотреть видео на экране монитора. Несмотря на то, что кинопленка уже стала историей, стандарт в 24 кадра в секунду остается основным для видеоконтента. Качественное видео иногда снимают с частотой в 60 кадров/сек, а вот большая частота кадров встречается редко. Причины примерно те же, что и сто лет назад: чем больше частота кадров, тем больше объем файла и выше требования к камере и к производительности процессора плеера. Поэтому нет никакого смысла в мониторе с частотой обновления больше 60 Гц, если он нужен вам для просмотров фильмов. По крайней мере, пока.

Кому же нужна высокая частота?

В абзаце, где шла речь о 24 кадрах, не зря упоминалась компьютерная игра. Именно в динамичных играх наиболее заметно влияние частоты обновления. Но если вы любите после работы «погонять в танчики», не спешите бежать в магазин за 240-герцовым монитором. Сначала определитесь, действительно ли вам нужна высокая частота обновления.

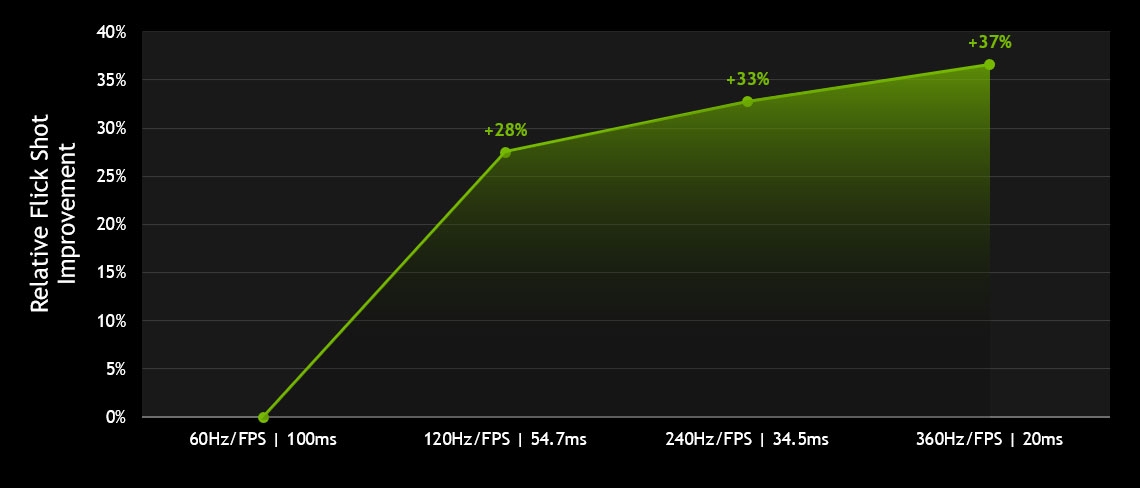

А вот киберспортсменам высокая частота обновления действительно важна. Игрок с монитором на 100 Гц получает реальное преимущество перед теми, кто «сидит» на 60 герцах. Именно по этой причине появляются мониторы с частотой 240, 280 и даже 360 Гц.

Впрочем, не все способны воспользоваться эффектом от увеличения частоты обновления. Исследования показали, что мозгу достаточно 13 мс на то, чтобы распознать изображение, но вот на то, чтобы правильно отреагировать на полученный кадр, может потребоваться в десятки раз больше времени. Не стоит рассчитывать, что, сменив монитор, вы сразу и многократно улучшите свои игровые показатели.

Частота обновления и вертикальная синхронизация

Еще один аргумент в пользу высокой частоты обновления — с ее помощью можно устранить влияние рассинхронизации частоты обновления и FPS игры. Поскольку эти числа часто не совпадают, может случиться так, что перерисовка кадра игры попадет на момент обновления экрана. В итоге на одну половину экрана будет выведен предыдущий кадр, а на другую половину — последующий.

Если кадры сильно отличаются (например, когда игрок быстро движется или крутится на месте), на экране будут заметны неприятные рывки изображения. Переход на большую частоту не избавит от этого явления, но оно станет куда менее заметным за счет того, что «резаный» кадр будет демонстрироваться намного меньше.

Некоторые мониторы предлагают решить эту проблему без увеличения частоты обновления — при помощи технологий (G-Sync, V-Sync и Freesync), подгоняющих перерисовку кадра к обновлению экрана.

Но и в этом решении есть минусы. Во-первых, технология должна поддерживаться как монитором, так и игрой. Во-вторых, при работе V-sync могут теряться некоторые кадры, что не нравится киберспортсменам.

Частота обновления и время отклика

Время отклика — это период, который требуется пикселям экрана для изменения цвета после получения соответствующей команды. Очевидно, что этот параметр связан с частотой обновления экрана: за время между сменами кадров экран должен не только успеть перерисоваться, но и некоторое время экспонироваться. К примеру, на частоте 100 Гц время демонстрации каждого кадра составляет 10 мс (1000 мс /100 Гц). Если время отклика монитора больше, то нет никакой пользы от высокой частоты обновления, даже наоборот — будет некоторый вред. Когда время отклика сравнимо со временем экспозиции кадра, в динамичных сценах пиксели не успевают «набрать» цвет и правильных цветов на экране вы просто не увидите. Зато заметите «след» старого изображения, отображающегося одновременно с новым.

Поэтому, выбирая монитор с высокой частотой обновления, смотрите, чтобы время отклика у него было минимальным и хотя бы не превышало интервал, необходимый на перерисовку кадра (1000 / частота в Гц).

Выводы

Высокая частота обновления монитора — это не то, что требуется каждому. Если вы не проводите часы за 3D-шутерами или симуляторами, вряд вы вообще ощутите эффект от увеличения частоты обновления. А вот киберспортсменам высокая частота обновления монитора даст реальное преимущество. Да и просто любители динамичных игр почти наверняка (если позволит производительность системы) заметят улучшение игрового процесса, которое последует за увеличением частоты.

Используем высокие разрешения на неподдерживающих их видеокартах

Засматриваетесь на 4K UHD-мониторы, но ваш лаптоп не поддерживает высокие разрешения? Купили монитор и миритесь с частотой обновления в 30Гц? Повремените с апгрейдом.

TL;DR: 3840×2160@43 Гц, 3200×1800@60 Гц, 2560×1440@86 Гц на Intel HD 3000 Sandy Bridge; 3840×2160@52 Гц на Intel Iris 5100 Haswell.

Предыстория

Давным-давно, когда все мониторы были большими и кинескопными, компьютеры использовали фиксированные разрешения и тайминги для вывода изображения на экран. Тайминги были описаны в стандарте Display Monitor Timings (DMT), и не существовало универсального метода расчета таймингов для использования нестандартного разрешения. Мониторы отправляли компьютеру информацию о себе через специальный протокол Extended display identification data (EDID), который содержал DMT-таблицу с поддерживаемыми режимами. Шло время, мониторам стало не хватать разрешений из DMT. В 1999 году VESA представляет Generalized Timing Formula (GTF) — универсальный способ расчета таймингов для любого разрешения (с определенной точностью). Всего через 3 года, в 2002 году, его заменил стандарт Coordinated Video Timings (CVT), в котором описывается способ чуть более точного рассчитывания таймингов.

История

Наконец-то настала эра высокой плотности пикселей и на ПК. На протяжении последних нескольких лет, нас встречал театр абсурда, когда на мобильные устройства ставят пятидюймовые матрицы с разрешением 1920×1080, полки магазинов уставлены большими 4K-телевизорами (хоть на них и смотрят с расстояния 2-4 метров), а мониторы как были, так и оставались с пикселями с кулак. Подавляющее большинство говорит, что Full HD выглядит «достаточно хорошо» и на 27″ мониторе, забывая, что предыдущее «достаточно хорошо» чрезвычайно быстро ушло после выхода iPad с Retina. Вероятнее всего, такая стагнация произошла из-за плохой поддержки высокой плотности пикселей в Windows, которая более-менее устаканилась только к выходу Windows 8.1.

Как бы то ни было, в 2015 году у нас есть выбор из 246 моделей 4K UHD-телевизоров и аж 36 моделей мониторов, одну из которых — Dell P2415Q — мне посчастливилось купить за сравнительно небольшие деньги (€377). Это 23.8-дюймовая модель с разрешением 3840×2160 и плотностью пикселей в 185 PPI, с возможностью подключения по DisplayPort 1.2 и HDMI 1.4. Первые 4K-мониторы определялись в системе как два отдельных монитора и комбинировались в один большой средствами драйвера видеокарты. Это было сделано из-за низкой производительности скейлеров, которые в то время не могли работать в полном разрешении, поэтому приходилось ставить два скейлера, каждый из которых выводил 1920×2160. Современные мониторы избавились от такого костыля, но, в то же время, стали требовать более производительные видеоадаптеры. К сожалению, мой уже сравнительно старый лаптоп Lenovo ThinkPad X220 не поддерживает, судя по информации на сайте Intel и от производителя, разрешения выше 2560×1440. Можно ли с этим что-то сделать? Как оказалось, можно.

Стандартные и нестандартные стандарты

Современным мониторам и видеокартам нет никакого дела до фиксированных разрешений и таймингов времен DMT, они могут работать в широком диапазоне разрешений и частот обновления. Давайте посмотрим в техпаспорт моего монитора:

| Поддерживаемая горизонтальная частота развертки | 31-140 кГц |

| Поддерживаемая вертикальная частота развертки | 29-76 Гц |

И максимальный пресет:

| Режим | Частота горизонтальной развертки | Частота вертикальной развертки | Частота пикселизации | Полярность синхронизации |

|---|---|---|---|---|

| VESA, 3840×2160 | 133.3 кГц | 60.0 Гц | 533.25 МГц | H+/V- |

Итак, почему лаптоп не может использовать максимальное разрешение?

Дело в частоте пикселизации. Многие видеокарты, а тем более интегрированное в процессор видео, имеют железные ограничения частоты пикселизации, а из-за того, что в EDID монитора нет максимального разрешения с меньшей частотой вертикальной развертки вследствие ограниченности его размера, компьютер не может использовать максимальное разрешение.

К сожалению, производители редко публикуют максимальную частоту пикселизации видеочипов, ограничиваясь максимальным поддерживаемым разрешением, но для интересующих меня карт я нашел необходимую информацию:

Intel HD 3000 (Sandy Bridge): 389 кГц

Haswell ULT (-U): 450 кГц

Haswell ULX (-Y): 337 кГц

Что делать и что сделать?

Ответ очевиден — нужно уменьшить частоту пикселизации! Ее уменьшение приведет и к уменьшению частоты обновления монитора. Как нам это сделать? Нам нужно сгенерировать так называемый modeline — информацию о таймингах для видеокарты и монитора. В сети можно найти множество генераторов modeline, но большинство из них безнадежно устарели и ничего не знают о стандарте CVT-R, который мы и будем использовать. Я рекомендую вам воспользоваться umc под Linux, PowerStrip под Windows и SwitchResX под Mac OS. К слову, SwitchResX — единственная программа, которая может рассчитывать modeline по стандарту CVT-R2, но мой монитор его не поддерживает.

Modeline содержит следующую структуру:

Посмотрите на таблицу выше: минимальная вертикальная частота обновления моего монитора может равняться 29 Гц.

Давайте сгенерируем modeline для разрешения 3840×2160 с частотой обновления в 30 Гц:

Как видим, частота пикселизации с данным режимом будет установлена в 262.75 МГц, что далеко от ограничений моего видеоадаптера.

Давайте попробуем установить и активировать наш режим:

Если все прошло удачно, вы увидите картинку в «неподдерживаемом» вашей картой разрешении на мониторе. Ура!

У нас все еще есть большой запас по частоте пикселизации, да и вряд ли кому-то будет комфортно использовать монитор с частотой обновления в 30 Гц, поэтому мы будем увеличивать ее до тех пор, пока частота пикселизации не приблизится к значению в 389 МГц — пределу моего видеоадаптера. Путем нехитрых манипуляций удалось установить, что при такой частоте мы получаем вертикальную развертку в 44.1 Гц.

Не блеск, но жить можно!

Как можно заметить, частота горизонтальной развертки — 97.25 кГц — вполне в диапазоне поддерживаемых монитором. Как в случае с вертикальной разверткой, так и в случае с разрешением, монитору нет дела до конкретных режимов, поэтому мы можем использовать 3200×1800 при 60 Гц — еще не такое низкое разрешение, как 2560×1440, и с привычной частотой обновления.

Для второго способа достаточно создать файл с Xorg-секцией «Monitor» и поместить его в /etc/X11/xorg.conf.d/ :

Где Identifier — название вашего видеовыхода согласно xrandr. Опцией «PreferredMode» можно задать режим, который будет выбран по умолчанию.

У меня не получается!

Убедитесь, что вы подключаете монитор через DisplayPort 1.2. HDMI 1.4 не позволяет использовать частоту пикселизации выше 340 МГц, в то время как для DisplayPort (HBR2) верхнее ограничение равно 540 МГц. Также удостоверьтесь, что ваш монитор поддерживает частоту обновления выше 30 Гц на максимальном разрешении, т.к. ранние модели этим грешили.

Заключение

Не стоит слепо верить технической документации на монитор. В ходе исследований оказалось, что ограничение по вертикальной частоте аж 86 Гц, вместо 76 Гц по заявлению производителя. Таким образом, я могу наслаждаться плавной картинкой, хоть и в не в самом высоком разрешении

Правда, мифы и особенности игровых мониторов — часть №1

В последние несколько лет явно прослеживается тренд на игровые комплектующие, и если с процессорами и видеокартами все вполне понятно, то игровые корпуса и игровые вентиляторы вызывают много вопросов. И, разумеется, стали появляться и игровые мониторы, причем массово: так, на CES 2020 было представлено около десятка моделей. Отношение к ним, в общем и целом, достаточно скептическое — дескать, обычных решений с FHD и 60 Гц полностью хватает, зачем эти навороты? Давайте разбираться, так ли это.

Раз глаз не видит больше 24 кадров, то зачем 144 Гц мониторы?

Когда речь заходит про герцовку монитора, то тут всплывают множество мифов. Самый популярный заключается в том, что раз фильмы показывают в 24 кадра в секунду, то, значит, нашему глазу этого достаточно, чтобы видеть не слайдшоу, а плавную картинку — а, значит, все эти 120 и даже 240 Гц мониторы — баловство. Однако тут важно понимать, что кадр из фильма и кадр, который видеокарта выводит на экран, сильно различаются. Кадр в фильме снимался с некоторой выдержкой, то есть он в любом случае слегка смазан и показывает движение, иными словами — внутри каждого кадра из фильма есть информация о предыдущем. Поэтому мозгу хватает всего 24 таких кадров секунду, что бы «слепить» из них плавное видео.

А вот кадр, который выводит на экран видеокарта, всегда четкий (разумеется, если мы не говорим о программном размытии в движении — motion blur), поэтому 24 таких кадра распознаются нашим мозгом как слайдшоу. Но сколько тогда нужно «компьютерных» кадров для плавности? А вот тут уже все индивидуально: в большинстве своем игроки на консолях вполне довольны 30 fps. Но на деле практически все люди замечают разницу между 30 и 60 Гц, а порог распознаваемости отдельных кадров лежит далеко за сотню — как показала презентация Nvidia на CES 2020, хватает людей, которые видят разницу между 240 и 360 Гц мониторами!

Но, разумеется, не стоит сразу бросаться покупать 240 Гц монитор. Проблема в том, что все его прелести вы сможете увидеть только в том случае, если контент будет выводиться со схожей частотой кадров. Иными словами, видео в 60 fps на YouTube будет выглядеть одинаково что на 60 Гц мониторе, что на 120 Гц, и даже на 360 Гц. В общем и целом, единственный контент, в котором вы можете увидеть под две сотни и больше кадров в секунду — это некоторые киберспортивные игры, и то для этого обычно потребуются быстрые процессоры и видеокарты.

В общем и целом, если вы не киберспортсмен, имеет смысл ограничиться 100-144 Гц мониторами. Выдать около сотни кадров в секунду в современных и не очень играх могут уже куда больше видеокарт, а разница с 60 Гц матрицами будет видна невооруженным глазом.

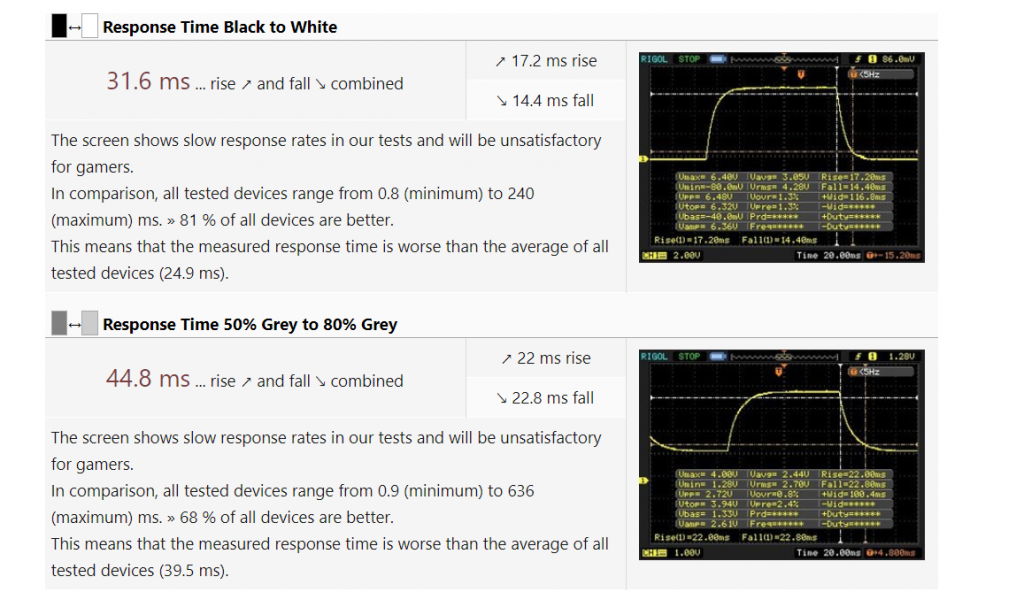

Время отклика монитора — не менее важный параметр, чем частота обновления

Думаю, многие замечали, что если быстро передвигать какое-либо окно по экрану, то за ним тянутся шлейфы. Это происходит из-за того, что пиксели в жидкокристаллических мониторах не могут изменять цвет моментально, им на это нужно определенное время — так называемая задержка матрицы или время отклика монитора.

Считать ее можно разными способами, в основном используют показатель grey-to-grey, или GtG: время, которое требуется пикселям, чтобы снизить яркость серого цвета с 80-90% до 10-50% (увы — каждый производитель тут использует свою методику). Данный показатель оказывается наиболее интересным, так как близок к реальному применению: очень редко в играх картинка резко сменяется с белой на черную (BtW, black-to-white), а вот смена яркости цветов происходит постоянно.

Типичная 60 Гц панель в достаточно дорогом ноутбуке с Core i5 и GTX 1660. Играть за ней в динамические игры будет не слишком приятно.

У обычных 60 Гц матриц такой показатель в среднем на уровне 30-50 мс. Много это или мало? Давайте посчитаем. В случае с 60 Гц монитором один кадр отображается на экране 1000 мс/60 = 17 мс. То есть время отклика соответствует отображению двух, а то и трех кадров на экране. К чему это приводит? Да ни к чему хорошему: в динамических играх матрица просто не будет успевать обновлять информацию на экране, что приведет к замыливанию картинки и шлейфам, а в худшем случае в этом цветовом месиве вы просто проглядите врага. В случае со 144 Гц мониторами все еще хуже: на каждый кадр отводится всего 7 мс.

Поэтому, выбирая игровой монитор, стоит внимательно отнестись к его времени отклика, причем не стоит смотреть на рекламные цифры в виде 1-3 мс: производители мониторов измеряют задержку различными хитрыми способами, и на деле по обзорам GtG может у таких матриц быть и 5, и 10 мс. Крайне желательно, чтобы время отображения кадра было больше времени задержки матрицы — это позволит свести шлейфы в динамических играх к минимуму.

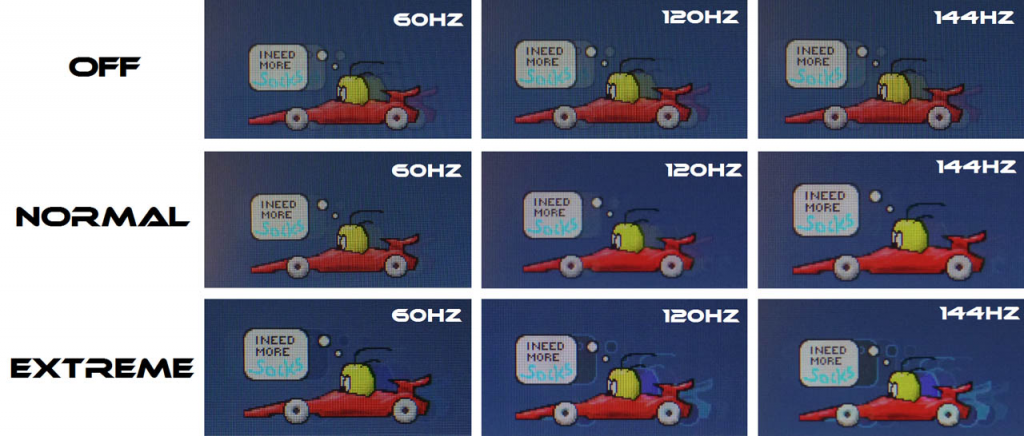

Overdrive — разгон матрицы

Вот мы и перешли к чисто игровым функциям. Как я писал выше, большое время отклика = смаз картинки, поэтому производители придумали технологию компенсации времени отклика, которую назвали Overdrive. В чем ее суть? Обычно переход от черного цвета к белому для LCD-матриц происходит быстрее, чем между двумя градациями серого. Причина в том, что скорость изменения состояния пикселя зависит от приложенного к нему напряжения, а переход в «белое» состояние — это подача максимального напряжения, поэтому BtW быстрее GtG (что, к слову, и используют маркетологи при указании времени отклика матриц).

Отсюда возникает простая идея: а что если в начале каждого нового кадра подавать на пиксель высокие «разгонные» импульсы напряжения, которые значительно выше тех, которые нужны для реального нового значения цвета? Это даст «толчок» пикселю и позволит ему быстрее перейти в новое положение, существенно снизив задержку матрицы. Однако ложка дегтя в том, что такое резкое повышение напряжения не может пройти бесследно: нет, пиксели от этого не выгорают, просто могут появиться различные артефакты изображения типа светлого мерцания на серых фонах в динамических играх.

Хорошо видно, что при включенном Overdrive в режиме Normal меньше всего артефактов изображения. При этом включение этой функции на Extreme начинает инвертировать цвета, что еще менее приятно, чем выключение этой опции.

По этой причине производитель монитора обычно делает несколько настроек Overdrive, в том числе и возможность полностью его выключить. И уже для конкретного монитора нужно смотреть, что лучше — опять же, об этом пишут в развернутых обзорах.

Высокая частота + низкое время отклика = приятный геймплей

Теперь сложим все воедино и посчитаем общую задержку, которую мы получаем в играх. Она складывается из времени, которое нужно процессору и видеокарте, чтобы обработать ваше нажатие и передать картинку на дисплей. Оно составляет около 50 мс и его вполне можно считать константой. Далее в дело вступает монитор: у нас есть задержка при выводе нового кадра + время отклика.

Посчитаем этот показатель для «стандартной» 60 Гц панели со временем отклика в 40 мс. Худшее время задержки при выводе нового кадра — это если только что на экран вывелся кадр, и теперь нужно ждать 1000 мс/60 = 17 мс, чтобы вывести новый (это на деле не совсем так, но мы рассматриваем наихудший случай). Далее — время отклика, еще 40 мс. В итоге общая задержка получается 50 + 17 + 40 = 107 мс.

Теперь возьмем «игровую» 144 гц матрицу с задержкой GtG в 7 мс (это опять же достаточно много для современных матриц, но мы берем худший случай). Задержка при выводе нового кадра — 1000 мс/144 = 7 мс. Еще 7 мс время отклика. В итоге получаем общую задержку в 50 + 7 + 7 = 64 мс.

Сложно сказать, как Nvidia считала задержку, однако статистика по флик-шотам (быстрым выстрелам с разворота) вполне красноречива: чем быстрее матрица, тем их больше. Причем основной прирост идет при переходе с 60 Гц на 120, что еще раз говорит о том, что переплачивать за более быстрые панели стоит только киберспортсменам.

В итоге выигрыш в задержке более полутора раз. И это главная причина того, что на быстрых матрицах вам проще играть и попадать во врагов. Так что, как видите, игровые мониторы действительно могут так называться, и это не маркетинг.

AMD FreeSync и Nvidia G-Sync — убираем разрывы в изображении

Большая часть мониторов имеют фиксированную герцовку, однако в динамическом контенте, таком как игры, количество кадров в секунду постоянно меняется. К чему это приводит? Опять же ни к чему хорошему: изображение выводится на дисплей даже в том случае, если вывод части предыдущего кадра ещё не закончен полностью — оставшаяся часть буфера приходится на текущее обновление экрана. Именно поэтому каждый выведенный на монитор кадр при несовпадении частоты и fps будет по сути состоять из двух кадров, отрендеренных видеокартой.

Выглядит это как разрыв изображения, что очень некрасиво:

Как можно в этим бороться? Ну, самый простой способ — это включить вертикальную синхронизацию, то есть принудительно выводить на экран столько кадров, сколько в нем герц. В случае, если видеокарта может выдать большее количество fps, она будет простаивать, а вы получите приятную нерваную картинку. Ну а если монитор 60 Гц, а видеокарта может выдать всего 30-40 fps? В таком случае некоторые кадры будут отображаться на экране вдвое дольше, чем должны, то есть задержка вывода будет скакать между 17 и 34 мс. Разумеется, это будет ощущаться на деле как «вязкое» управление, и играть так будет неприятно.

Какой выход из данной ситуации? Принудительно синхронизировать частоту обновления монитора с количеством кадров, выводимых видеокартой. Иными словами, монитор будет подстраиваться под видеокарту и выводить кадр столько времени, сколько нужно видеокарте на рендеринг следующего, который он снова выведет без всяких задержек. Как итог — вы получаете по сути вертикальную синхронизацию при любом fps. Ну, почти любом.

На данный момент существуют две технологии, которые позволяют убрать разрывы при выводе динамического контента — это AMD FreeSync и Nvidia G-Sync. Разница между ними в том, что первая технология использует для синхронизации частоты развертки и fps видеокарту, а данные об этом передаются по DisplayPort. Вторая технология требует в мониторе наличия специального чипа, который пропускает через себя видеопоток с видеокарты и «подгоняет» под него частоту обновления монитора. Очевидно, что второй подход дороже, причем временами значительно: переплата за чип от Nvidia доходит до 10-20 тысяч рублей.

Что же лучше? Еще год назад я бы сказал, что этот вопрос не корректен: видеокарты от AMD умеют работать только с FreeSync, а видеокарты от Nvidia умели тогда работать только с G-Sync. Однако с учетом того, что видеокарты GTX 1000 и RTX 2000 используют видеоинтерфейс DisplayPort 1.2, дабы соответствовать требованиям VESA компании Nvidia пришлось некоторое время назад добавить в вышеуказанные видеокарты поддержку FreeSync под видом G-Sync Compatible.

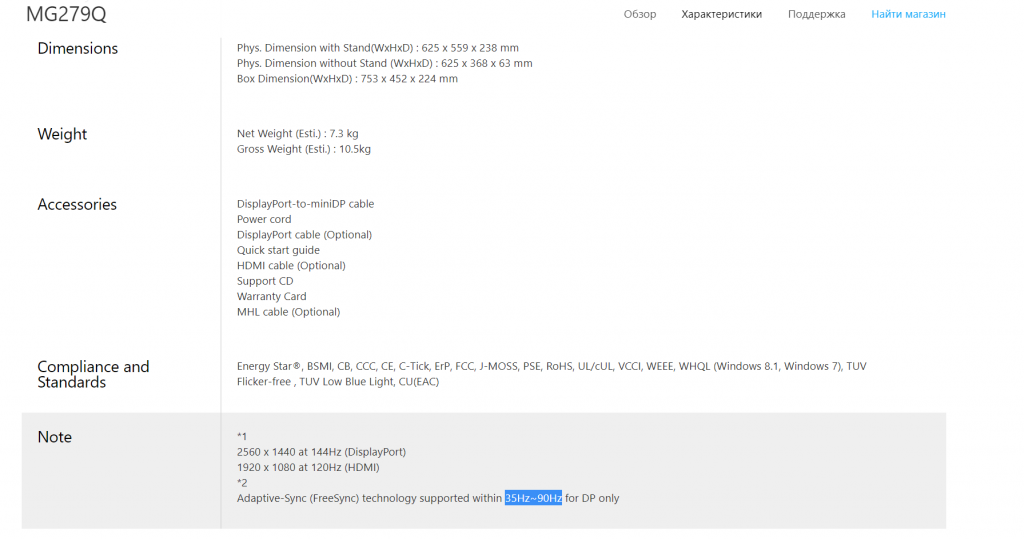

Выходит, что переплачивать за G-Sync теперь нет смысла? Опять же не совсем так. В теории, FreeSync может работать на частотах обновления монитора от 9 до 240 Гц, чего более чем достаточно для подавляющего большинства мониторов и игр. Но что мы видим на практике? Многие даже достаточно дорогие мониторы с ценником выше 1000 долларов поддерживают адаптивную герцовку лишь в узком диапазоне 48-90 Гц (весь список мониторов есть тут). И это при том, что сами они могут быть и 144 Гц! То есть получается, что или вы теряете преимущества быстрой матрицы и играете с

60 fps, или же вы забываете про FreeSync и играете со 100+ fps, но терпите разрывы изображения.

144 Гц, IPS, разрешение 2К — и поддержка FreeSync мелким текстом внизу: от 35 до 90 Гц. Смысл в ней в таком диапазоне не совсем понятен.

Разумеется, есть и такие мониторы, которые поддерживают FreeSync в диапазоне от 48 до 240 Гц, но их очень немного. При этом у мониторов с G-Sync такой проблемы нет: все они гарантированно поддерживают адаптивную герцовку в диапазонах от 30 Гц до родной частоты обновления матрицы. Согласитесь, это куда приятнее и охватывает весь диапазон «играбельного» fps.

В итоге ситуация получается следующей: для пользователей видеокарт от AMD выбора нет, не хотите видеть разрывы — берите монитор с FreeSync, хотите при этом высокую герцовку — придется поискать подходящее решение, которое зачастую может быть дороже видеокарты. Для пользователей видеокарт от Nvidia ситуация интереснее: если хотите плавную картинку без разрывов при любом нормальном fps — имеет смысл переплатить за монитор с G-Sync. Но если есть желание сэкономить — можете окунуться в мир FreeSync мониторов, которых на данный момент около 1000 штук. Драйвером поддерживаются они все, так что выбор по герцовке остается только за вами.

Во второй и заключительной части статьи мы поговорим про остальные «фишки» игровых мониторов, такие как многозонная подсветка, вставка черного кадра и некоторые другие.